Por: Alvaro Duque Soto*

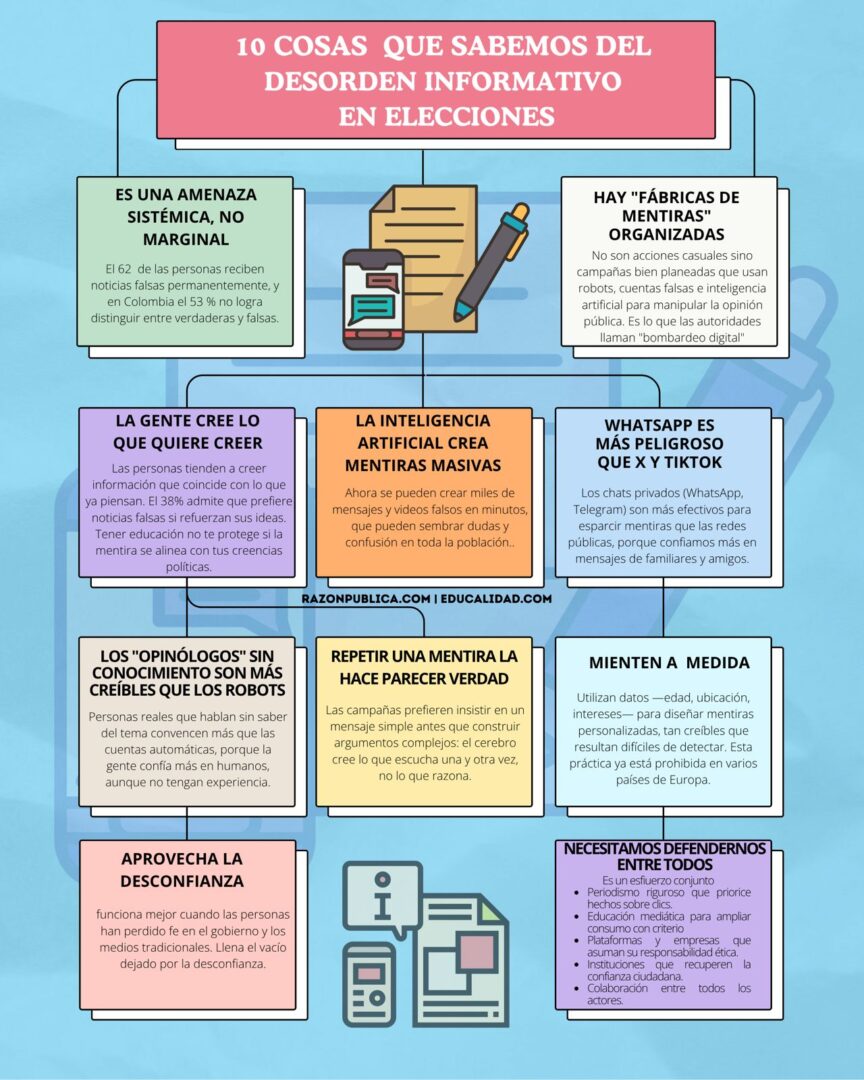

Las elecciones de Consejos de Juventud y la consulta interna del Pacto Histórico Colombia marcan el inicio de un ciclo electoral que definirá nuevo Congreso y presidente. Más allá del riesgo de violencia —que ya ha costado la vida de un precandidato—, la mayor amenaza es el desorden informativo (DI), un desafío central para las democracias actuales.

Aunque muchos hablan de desinformación, DI es un concepto más amplio: incluye mentiras deliberadas; errores involuntarios; datos tergiversados; rumores y contenidos creados para confundir, distraer o generar desconfianza.

Hoy conocemos este fenómeno mejor que hace una década. En ese momento un cambio radical en su escala, intensidad y capacidad de operación lo transformó. Dejó de ser un problema ocasional para convertirse en una amenaza latente para los sistemas democráticos.

Ahora sabemos cómo actúa, quién lo financia, qué vulnerabilidades explota y de qué manera se adapta a contextos culturales, económicos y políticos para ser más efectivo. Ya no se trata de opiniones aisladas en redes, sino de una maquinaria profesional con recursos, tiempo y objetivos bien definidos.

El terreno abonado: 3 oleadas + 4V + 3D + 3P

El actual DI en períodos electorales deriva de tres oleadas tecnológicas. Primero, las redes sociales normalizaron bots y campañas automatizadas, lo que permitió difundir mensajes sin rastros de autoría. Luego, el Big Data impulsó la segmentación de audiencia, al adaptar narrativas manipuladoras a perfiles psicológicos y emocionales específicos. Ahora, la Inteligencia Artificial generativa ha eliminado barreras técnicas para fabricar audios, videos e imágenes falsas.

Estas transformaciones han configurado un ecosistema definido por cuatro V: La velocidad con la que circula la información no tiene precedentes. El volumen de contenido crece sin límites y sin filtros que separen lo verdadero de lo falso. Su viralidad se nutre de emociones intensas que nos convierten en sus difusores involuntarios. Y su verosimilitud es tan grande, que verificar los hechos se vuelve una tarea compleja.

También te puede interesar: https://razonpublica.com/detector-de-humo-contra-el-desorden-informativo-10-breviario-para-desenmascarar-manipulaciones-visuales-de-datos/

Pero el problema no es solo tecnológico. Tres dinámicas sociales lo agravan: desconexión institucional, descontento ciudadano y desafección política. En ese vacío, el DI prospera porque ofrece narrativas que reemplazan datos y brindan certezas falsas pero reconfortantes.

A eso se suman las tres P que caracterizan y ponen en riesgo las democracias actuales: populismo (la política como espectáculo), polarización (el adversario como enemigo) y posverdad (hechos y propaganda se confunden). Aquí la información no busca ser creíble, sino sembrar duda, indignación o miedo.

El veneno que no se ve

El DI actúa como estrategia planificada para debilitar instituciones, distorsionar percepciones y condicionar el voto. El acto electoral, que debería resultar de una deliberación racional, se vuelve una reacción visceral. Y esa estrategia se adapta a nuestra arquitectura mental.

Si antes hablábamos de cámaras de eco y de burbujas informativas, hoy enfrentamos algo más complejo: burbujas cognitivas. No dependen de redes ni algoritmos. Son sistemas psicológicos que operan en tres niveles: filtran lo que coincide con creencias, refuerzan identidad a través de ellas y rechazan contradicciones.

Cuando se combinan con las cámaras de eco (lo que repite nuestro entorno) y las burbujas informativas (lo que los algoritmos deciden mostrarnos), forman un circuito cerrado que nos lleva a que creamos lo que queremos creer.

Daniel Iriarte lo llama “enamoramiento ideológico”. Por eso la preferencia política se convierte en parte de la identidad y criticar una idea se percibe como un ataque personal. En esas condiciones, el DI no necesita argumentos, le basta con despertar emociones y confirmar identidades. Adriana Amado lo resume: “La certeza no se sigue de la información, sino que la precede. Las convicciones no piden a sus fuentes evidencias verificables”.

Aquí surge una paradoja: sabemos que el DI es un riesgo, pero no lo detectamos cuando lo tenemos frente a nosotros. No se presenta como una mentira descarada, sino como conversación familiar, opinión compartida, como “eso que todo el mundo sabe”. Es como si supiéramos que el veneno existe, pero lo consumiéramos sin darnos cuenta porque viene disuelto en lo cotidiano, en lo que nos parece natural.

También te puede interesar: https://educalidad.com/educalidad-en-la-semana-de-la-ami

Precisamente esa invisibilidad es la que aprovecha la industria del DI, que sigue patrones deliberados documentados en decenas de elecciones recientes. Su estrategia se desarrolla en cuatro fases: cimentación (construir redes de confianza con contenido aparentemente inocuo), activación (difundir rumores ya sembrados en la fase anterior, presentándolos como opiniones espontáneas), saturación (inundar el espacio de contenidos falsos o manipulados para generar caos, en los días previos a los comicios), y disputa (convertir errores menores en “pruebas” de fraude, luego de las elecciones).

Colombia ya está inmersa en la primera fase. No hay estruendo que delate su presencia, pero los canales están activos y las audiencias se están preparando. Por eso, identificar ahora los factores que sostienen el DI, en esta fase silenciosa, es una forma de evitar que, cuando la campaña arrecie, ya sea demasiado tarde.

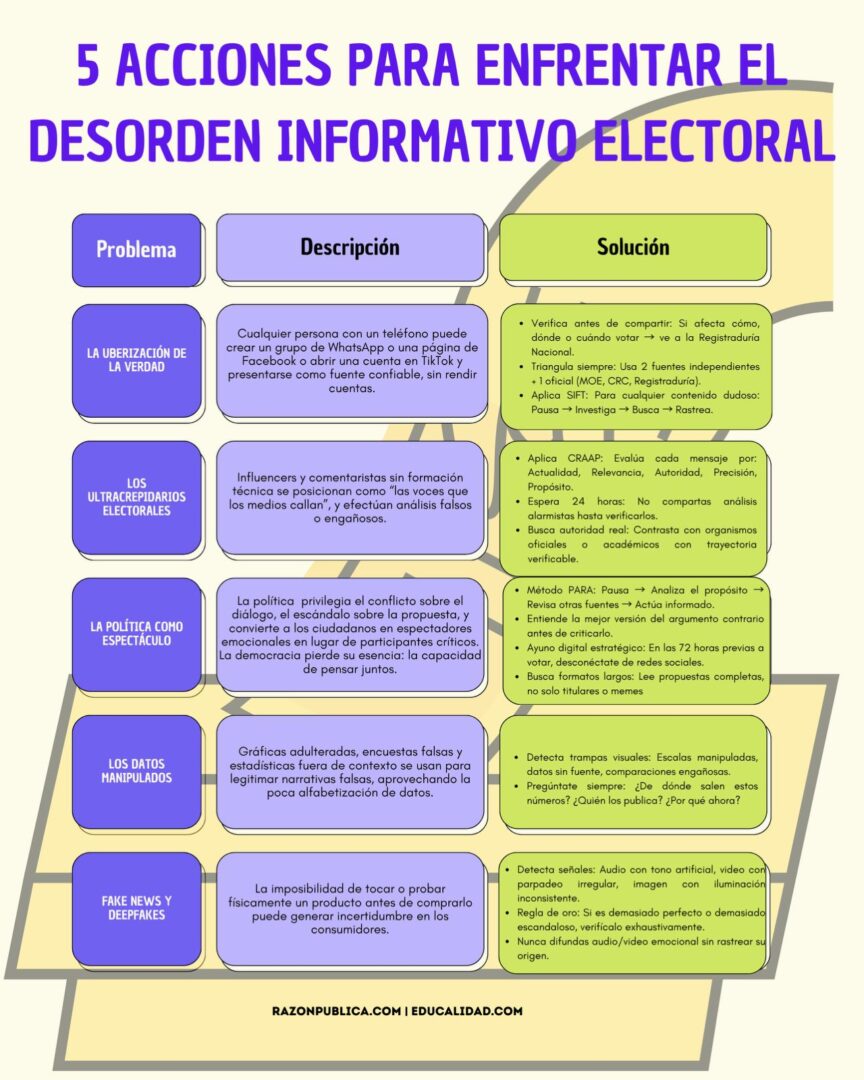

Factor 1: La uberización de la verdad electoral

Así como Úber convirtió a cualquiera con un carro en taxista, la desintermediación digital ha convertido a cualquiera con un celular en “informador electoral” sin formación, responsabilidad ni filtros.

En Colombia, el principal vehículo de este factor son las cadenas de WhatsApp y los perfiles de TikTok. Primero construyen confianza con contenido cotidiano —recetas, chismes— y luego introducen gradualmente “información electoral” que parece oficial sin serlo. La cercanía se vuelve garantía de veracidad: si lo dice el grupo de confianza, debe ser cierto.

La desintermediación total genera un problema: cuando llegue la parte intensa de la campaña, esos canales tendrán audiencias que confían más en ellos que en fuentes oficiales.

Factor 2: Los ultracrepidarios que fijan la agenda

Del latín ultra crepidam: quien opina más allá de su competencia. Son influencers, “streamers” y comentaristas sin formación en temas electorales, pero con miles o millones de seguidores. Se presentan como “voces que dicen lo que los medios callan”. Y ganan credibilidad entre quienes desconfían de todo.

Sus mensajes se expanden a través de “granjas digitales”: redes de cuentas falsas o automatizadas (bots) que simulan un consenso masivo para que un mensaje marginal parezca la opinión mayoritaria. En Colombia, estos actores pululan en Tik Tok, YouTube y X, donde sus análisis sin rigor técnico se viralizan.

Este fenómeno prospera porque cada vez más ciudadanos se informan exclusivamente en esas redes, donde no existen mecanismos de verificación ni estándares editoriales. En esos espacios se genera un caldo de cultivo perfecto para el DI: en tiempos de desconfianza institucional, la gente no confía en quien sabe más, sino en quien les resulta cercano, repetido o reconocible —aunque ese alguien no tenga ninguna competencia real.

Factor 3: El reality show que monetiza la polarización

La economía de la atención ha infiltrado los procesos electorales. Los algoritmos premian el conflicto, no el argumento. Así surgen los “candidatos payaso”: diseñados para generar escándalo, no propuestas.

En la cimentación, las audiencias se acostumbran a “píldoras políticas” de alto impacto emocional. Cuando la campaña entre en otra fase, ya estarán condicionadas a reaccionar con rabia, miedo o burla.

El debate serio pierde espacio porque el modelo de negocio premia a los más estridentes, en detrimento de figuras que proponen debates serios.

Factor 4: Cifras que parecen objetivas, pero engañan

Las cifras parecen objetivas, pero pueden ser instrumento de engaño. Y a veces una norma bien intencionada agrava el problema. Sucedió con la ley que restringió la publicación de encuestas formales antes de la inscripción de candidatos.

Al crear un vacío de información regulada, proliferaron “encuestas” apócrifas en chats y grupos cerrados: gráficos adulterados, cifras inventadas presentadas como “exclusivas” o “filtradas”. Sin responsable ni metodología.

El objetivo no es imponer una mentira, sino sembrar duda. En un entorno donde todo se cuestiona, la desconfianza se convierte en la única certeza —y eso puede ser más peligroso que cualquier mentira concreta.

Factor 5: La IA que fabrica realidades convincentes

La IA generativa permite crear audios, videos, imágenes y textos sintéticos indistinguibles del real. En Rumanía, en 2024, esto obligó a repetir las elecciones luego de una interferencia masiva que usó contenido de IA en TikTok.

En Colombia ya opera de forma discreta: imágenes levemente alteradas de documentos oficiales, textos generados automáticamente que parecen análisis profesionales sin serlo. Al final, se crea el “dividendo de la mentira”: un estado donde, si todo puede ser falso, la ciudadanía desconfía de cualquier evidencia, y la verdad deja de importar.

La batalla que empieza antes de empezar

Estos cinco factores no actúan por separado, sino como engranajes de una misma maquinaria. La uberización abre espacio a voces sin fundamento, el espectáculo reemplaza el debate, los datos falsos generan desconfianza, la inteligencia artificial vuelve creíble lo increíble y las burbujas cognitivas hacen que cada mensaje impacte donde somos más vulnerables.

Juntos han convertido el DI en una industria de la que se lucran plataformas que monetizan la atención y asesores que promueven campañas basadas solo en emociones primarias. Y en un país como Colombia, donde menos de la mitad de la población identifica información falsa (según la Registraduría), este fenómeno reduce la capacidad de análisis y corroe los cimientos mismos de la vonviciencia democrática.

Norberto Bobbio advertía que las democracias no mueren de golpe, sino que se desgastan en silencio. Y señalaba que su única defensa es una ciudadanía que piensa por sí misma, que cuestiona antes de aceptar. Hoy, el DI es uno de los principales agentes de ese desgaste. De ahí que enfrentarlo también es una oportunidad para construir una democracia más consciente.

La evidencia internacional muestra que ninguna solución aislada funciona. Se requiere intervenir en tres momentos: antes de que el contenido falso se cree, mientras circula sin ser reconocido, y después de identificado. La respuesta combina alfabetización mediática, herramientas de verificación en tiempo real, regulación que proteja la libertad de expresión y detenga la manipulación deliberada, compromisos públicos para no usar el engaño como estrategia, y acuerdos con plataformas para contener la circulación de contenido falso.

Sin embargo, la defensa más efectiva sigue siendo individual y colectiva. La capacidad de cuestionar y contrastar información no nace el día de las elecciones, se forma con el hábito de no compartir sin verificar, desconfiar de lo que solo confirma nuestros prejuicios y exigir evidencia antes de creer.

Las votaciones comienzan este domingo. Este trabajo empieza ahora, en estos días aparentemente tranquilos, antes de que el ruido de campaña se vuelva imposible de detener.

*Ph.D. en Ciencia Política de la Universidad de Turín (Italia). Ha sido docente e investigador de temas de comunicación política, periodismo y educación mediática e informacional. Miembro del equipo Educalidad.