Por: Alvaro Duque Soto*

Cada vez que un chatbot nos atrapa en túneles infinitos de preguntas para cancelar un servicio o pedir una cita, nos dan ganas de mandar a la porra al interlocutor digital. Pero mientras maldecimos, casi nunca nos damos cuenta de que estamos ante la gobernanza algorítmica en acción, donde instituciones delegan decisiones cruciales a estructuras de inteligencia artificial.

Esta frustración de la que todos tenemos anécdotas esconde una transformación profunda del poder. Ya no usamos herramientas para automatizar respuestas, estamos entrando en la era agéntica, en la que personas y máquina se mezclan en cada paso. No es el humano decidiendo con ayuda de la máquina, ni la máquina ejecutando órdenes humanas, sino una entidad nueva donde ambos se fusionan hasta volverse indistinguibles. El piloto automático ya no solo conduce: redefine el destino.

En nuestras democracias, ya debilitadas por la apatía ciudadana, dejar que las máquinas decidan empeora las cosas, pues, a menudo, mientras menos entendemos cómo funciona el sistema, menos participamos. Y mientras menos participamos, más poder acumulan las máquinas.

Una invasión silenciosa

Para entender el alcance, olvidémonos de la idea de que la IA es una herramienta neutral. Como toda tecnología, Siris, Alexas y sucedáneos no nos hablan inocentemente. En aulas y oficinas, por ejemplo, estos sistemas ya operan como co-decisores que persiguen objetivos sin supervisión humana constante.

Si por casualidad se nos permite hablar con un humano, el algoritmo ya filtró qué vemos en pantalla, en qué orden, con qué prioridad. Las opciones de respuesta, los criterios y la definición del problema vienen pre-concebidos por mecanismos que poco se entienden y aceptamos sin cuestionar.

También te puede interesar: https://razonpublica.com/detector-humo-desorden-informativo-12-nos-manipulan-interpretaciones-selecciones-sesgadas/

En educación, plataformas como Duolingo prometen personalización. Cierto, detectan rezagos y sugieren refuerzos. Pero también disponen de modo unilateral qué lección sigue, qué errores importan, cuándo repetir conceptos. El estudiante no aprende a su ritmo; se adapta al de la máquina. Los docentes quedan como operadores de un sistema que ya decidió qué y cómo enseñar. Y pueden terminar como meros verificadores de respuestas predefinidas, al tiempo que los estudiantes pierden la capacidad crítica que debería ser su centro.

En oficinas públicas y privadas, los algoritmos clasifican ciudadanos en categorías que no vemos pero que determinan nuestro acceso a servicios: «elegible», «riesgo medio», «rechazado». Quedamos clasificados sin saber por qué. E incluso sucede que los funcionarios aplican decisiones que no comprenden. Cuando algo falla, el funcionario de turno culpa al sistema, los desarrolladores culpan a los datos, los datos reflejan decisiones pasadas. Al final, no queda nadie ante quien reclamar.

Aquí hay un punto clave: estamos frente a un nuevo tipo de desorden informativo. No son las típicas noticias falsas, errores, sátiras o propaganda— sino algo más silencioso: la imposibilidad estructural de entender quién toma las decisiones que afectan nuestras vidas.

Pensemos en esto: cada vez que un algoritmo decide si calificamos para un crédito, qué expediente judicial ve primero un juez, o qué lección siguen nuestros hijos en el colegio, no sabemos bien por qué se tomó esa decisión. Este es uno de los mayores desafíos de hoy: no es que haya información falsa, sino que la información real no siempre nos permite entender cómo funciona el sistema que nos empieza a gobernar.

Solucionismo tecnológico

Lo inquietante no es que las máquinas tomen decisiones, sino la emergencia de zonas grises donde ya no distinguimos qué fue humano y qué algorítmico.

Uno entiende que no se mienta la soga en casa del ahorcado, pero llama mucho la atención que en el reciente congreso Fintech de Barranquilla, ningún precandidato presidencial mencionara los riesgos de automatizar el sistema financiero.

Ese mutismo es elocuente: mientras la ciudadanía queda al margen, el poder real se concentra en corporaciones tecnológicas y sistemas automáticos sin control democrático efectivo, pues poco a poco se desplaza el centro de las decisiones hacia una gobernanza que nadie ha elegido.

Como estamos en campaña, las promesas abundaron: IA para democratizar créditos, algoritmos para combatir el fraude, automatización para reducir costos. En cambio, brillaron por su ausencia preguntas cruciales: ¿Quién controla estos sistemas? ¿Bajo qué reglas operan? ¿Para beneficio de quién?

Es claro que en un país donde el gota a gota cobra vidas a diario, la automatización del sistema es urgente. Pero ¿por qué no se habla de esa redefinición del poder ya en marcha, que se negocia entre Estado, oligopolios bancarios y startups Fintech? Los ciudadanos, por nuestra parte, quedamos como espectadores de medidas que definirán nuestro acceso al crédito, al ahorro, a la vida económica misma.

Los políticos abrazan el «solucionismo tecnológico» del que habla Evgeny Morozov: presentan la IA como varita mágica contra corrupción, desigualdad e ineficiencia, sin explicar quién la controlará. No es que no entiendan; es que la confusión les conviene. Mientras debatimos esas promesas deslumbrantes, el verdadero poder migra de forma sigilosa hacia algoritmos de empresas que nadie eligió.

Nuevas exclusiones

Imaginemos la aprobación de un crédito de vivienda en ese futuro fintech del que se hablaba en el congreso: el asesor bancario ingresa datos, el mecanismo evalúa riesgo crediticio, sugiere monto y tasa, el asesor ajusta según su experiencia, el sistema aprende de ese ajuste y modifica futuras evaluaciones. Después de miles de casos procesados, ¿quién decidió negarle el crédito a una familia? No fue el asesor solo ni el algoritmo solo, sino la entidad híbrida que emerge de su fusión.

También te puede interesar: https://educalidad.com/educalidad-en-la-semana-de-la-ami

Esta simbiosis financiera diluye la responsabilidad con consecuencias preocupantes. Cuando el algoritmo discrimina por lugar de residencia, edad o apellido, ¿a quién demandar? ¿Al banco que compró el software? ¿A la fintech que lo desarrolló? ¿Al asesor que validó la recomendación? ¿A los datos que reflejan décadas de exclusión bancaria?

No podemos protestar frente a una sucursal porque el poder crediticio está atomizado en millones de micro-decisiones algorítmicas. Sin poder rastrear quién decidió qué, no hay a quién reclamar. La promesa de inclusión financiera podría esconder, por tanto, nuevas formas de exclusión digital.

La tinderización de la vida

La transformación trasciende quién decide: estamos rediseñando la sociedad para hacer que pueda seguir procesos automatizados, para que las máquinas comprendan nuestras acciones.

Es una tinderización exacerbada. Como si convirtiéramos cada decisión importante de la vida en una aplicación de citas: deslizar a la derecha para ‘contratable’ o a la izquierda para ‘no contratable’, ‘confiable’ o ‘riesgoso’, ‘elegible’ o ‘rechazado’. En este proceso, perdemos justo lo que nos hace humanos: la capacidad de manejar la ambigüedad, las contradicciones y todos esos matices que no caben en un simple ‘me gusta’ o ‘no me gusta’. Y aquí está un problema grave: no es que la realidad sea falsa, sino que la simplificamos tanto que termina deformada.

Como planteaba Annie Lowrey en The Atlantic, un currículum ya no narra una historia profesional, sino que apila palabras clave para filtros automáticos. Los candidatos a un trabajo usan ChatGPT para escribir aplicaciones que leerá otra IA —un teatro del absurdo donde nadie habla con nadie.

Reglas para co-gobernar con máquinas

En esa transición que vivimos a trompicones, Colombia muestra muchas grietas, como queda de manifiesto en dos casos recientes. La auditoría de la Contraloría a Nueva EPS destapó un desastre de datos: millones de facturas sin procesar y duplicadas. Para solucionar este caos, ahora prometen usar “robótica, ciencia de datos e IA”. Paradójicamente, el mismo desorden que creó la crisis ahora se usa para entregar más poder a cajas negras algorítmicas, lo que podría institucionalizar la corrupción en lugar de combatirla.

El segundo caso es más peliagudo. Como el Acuerdo Marco de Nube Pública terminó el 1 de septiembre de 2025, muchos colombianos han descubierto una verdad incómoda: no sabían que la mayoría de las historias clínicas, expedientes judiciales, trámites ciudadanos —buena parte de la memoria digital del país— reside en servidores de Amazon, Google, Microsoft y Oracle, sujetos a legislaciones extranjeras.

¿Cómo construir gobernanza algorítmica soberana cuando los datos que alimentan esos algoritmos están en otros países? ¿Cómo garantizar privacidad ciudadana cuando no controlamos la infraestructura? Sin transparencia ni responsabilidad clara, los ciudadanos quedamos en la oscuridad sobre quién controla los datos y cómo se toman las decisiones que impactan nuestras vidas. Como dijo el bobo: es pretender regular el tráfico de Bogotá cuando las calles pertenecen a Silicon Valley, a Shenzhen o a los Emiratos Árabes.

Recuperar el control

Enfrentar esta realidad no puede llevarnos a reaccionar de forma ludita —destruyendo las máquinas— ni ingenua —abrazándolas sin condiciones—. Los sistemas híbridos ya están aquí. La pregunta es qué tipo de síntesis construimos: ¿una donde humanos y algoritmos se potencian mutuamente o una donde lo humano se deforma para encajar en variables que las IA puedan entender?

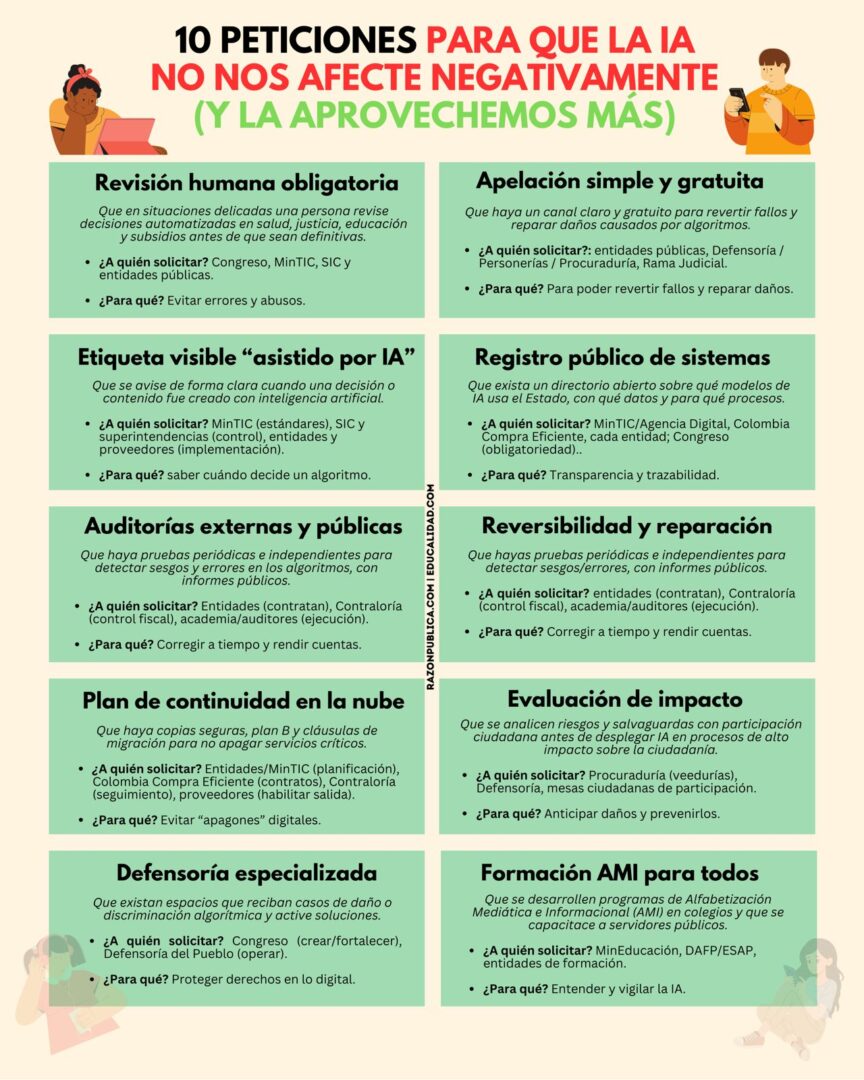

Sin marcos regulatorios claros, sin infraestructura digital propia, la promesa de gobernanza algorítmica responsable es pura retórica. Necesitamos tres transformaciones urgentes:

- Transparencia radical: Todo sistema que tome decisiones públicas debe poder explicarse en lenguaje sencillo —no en jerga técnica—. Si un algoritmo niega un crédito o un subsidio, el afectado merece saber por qué, con qué datos, bajo qué criterios. La opacidad no puede ser modelo de negocio ni escudo burocrático.

- Soberanía digital: Los datos de los colombianos deben residir en infraestructuras que podamos auditar, regular y proteger. No podemos construir futuro digital dependiendo de la benevolencia de corporaciones extranjeras o de contratos que vencen sin plan B.

- Alfabetización crítica: Más allá de enseñar a usar ChatGPT, necesitamos co-gobernantes digitales que entiendan cómo interrogar sistemas automatizados, exigir rendición de cuentas algorítmica, reconocer cuándo estamos siendo controlados por una máquina.

El poder está mutando y la ventana para actuar se cierra. En lugar de detener un futuro irreversible, debemos decidir si seremos sus arquitectos o sus víctimas. El piloto automático ya está activo. La pregunta es si conservamos la capacidad de retomar los mandos cuando sea necesario —o si estamos perdiendo el rumbo. Por eso, la próxima vez que queramos mandar a la porra a un sistema automatizado, recordemos que debemos y podemos exigir que las máquinas trabajen para nosotros, no al revés; que la tecnología amplíe la democracia en lugar de vaciarla.

En el 12º. Foro de Gobernanza de Internet Colombia se reflexionó sobre el asunto. Y en octubre la Mesa Multiactor sobre Inteligencia Artificial seguirá el debate. Ahí podremos ir respondiendo una pregunta importante: ¿estamos listos para decidir quién gobierna en la era algorítmica?

En el próximo artículo: La IA ya decide por nosotros. Pero no tiene por qué hacerlo en la penumbra. Exploraremos cómo, desde conversaciones en casa hasta las leyes que se discuten en el Congreso, podemos empezar a entenderla, cuestionarla y exigir que funcione para todos.

*Ph.D. en Ciencia Política de la Universidad de Turín (Italia). Ha sido docente e investigador de temas de comunicación política, periodismo y educación mediática e informacional. Miembro del equipo Educalidad.